Факторная матрица. Основные теоретические понятия факторного анализа

Следующий пример основан на вымышленных данных, относящихся к изучению удовлетворенности жизнью. Предположим, что вопросник был направлен 100 случайно выбранным взрослым. Вопросник содержал 10 пунктов, предназначенных для определения удовлетворенности на работе, удовлетворенности своим хобби, удовлетворенностью домашней жизнью и общей удовлетворенностью в других областях жизни. Ответы на вопросы были введены в компьютер и промасштабированы таким образом, чтобы среднее для всех пунктов стало равным приблизительно 100.

Результаты были помещены в файл данных Factor.sta. Открыть этот файл можно с помощью опции Файл - Открыть; наиболее вероятно, что этот файл данных находится в директории /Examples/Datasets. Ниже приводится распечатка переменных этого файла (для получения списка выберите Все спецификации переменных в меню Данные).

Цель анализа . Целью анализа является изучение соотношений между удовлетворенностью в различных сферах деятельности. В частности, желательно изучить вопрос о числе факторов, "скрывающихся" за различными областями деятельности и их значимость.

Выбор анализа. Выберите Факторный анализ в меню Анализ - Многомерный разведочный анализ для отображения стартовой панели модуля Факторный анализ. Нажмите на кнопку Переменные на стартовой панели (см. ниже) и выберите все 10 переменных в этом файле.

Другие опции . Для выполнения стандартного факторного анализа в этом диалоговом окне имеется все необходимое. Для получения краткого обзора других команд, доступных из стартовой панели, вы можете выбрать в качестве входного файла корреляционную матрицу (используя поле Файл данных). В поле Удаление ПД вы можете выбрать построчное или попарное исключение или подстановка среднего для пропущенных данных.

Задайте метод выделения факторов. Нажмем теперь кнопку OK для перехода к следующему диалоговому окну с названием Задайте метод выделения факторов. С помощью этого окна диалога вы сможете просмотреть описательные статистики, выполнить множественный регрессионный анализ, выбрать метод выделения факторов, выбрать максимальное число факторов, минимальные собственные значения, а также другие действия, относящиеся к специфике методов выделения факторов. А теперь перейдем во вкладку Описательные.

Просмотр описательных статистик. Теперь нажмите на кнопку Просмотреть корр./средние/ст.откл. в этом окне для того, чтобы открыть окно Просмотр описательных статистик.

Теперь вы можете рассмотреть описательные статистики графически или с помощью таблиц результатов.

Вычисление корреляционной матрицы. Нажмите на кнопку Корреляции во вкладке Дополнительно для того, чтобы отобразить таблицу результатов с корреляциями.

Все корреляции в этой таблице результатов положительны, а некоторые корреляции имеют значительную величину. Например, переменные Hobby_1 и Miscel_1 коррелированны на уровне 0.90. Некоторые корреляции (например, корреляции между удовлетворенностью на работе и удовлетворенностью дома) кажутся сравнительно малыми. Это выглядит так, как будто матрица имеет некоторую отчетливую структуру.

Метод выделения. Теперь нажмем кнопку Отмена в диалоговом окне Просмотр описательных статистик для того, чтобы вернуться в диалоговое окно Задайте метод выделения факторов. Вы можете сделать выбор из нескольких методов выделения во вкладке Дополнительно (см. вкладку Дополнительно диалогового окна Задайте метод выделения факторов для описания каждого метода, а также Вводный обзор с описанием метода Главных компонент и метода Главных факторов). В этом примере по умолчанию принимается метод Главных компонент, поле Макс. число факторов содержит значение 10 (максимальное число факторов в этом примере) и поле Мин. собств. значение содержит 0 (минимальное значение для этой команды).

Для продолжения анализа нажмите кнопку OK.

Просмотр результатов. Вы можете просмотреть результаты факторного анализа в окне диалога Результаты факторного анализа. Сначала выберите вкладку Объясненная дисперсия.

Отображение собственных значений . Назначение собственных значений и их полезность для пользователя при принятии решения о том, сколько следует оставить факторов (интерпретировать) были описаны в Вводном обзоре. Теперь нажмем на кнопку Собственные значения, чтобы получить таблицу с собственными значениями, процентом общей дисперсии, накопленными собственными значениями и накопленными процентами.

Как видно из таблицы, собственное значение для первого фактора равно 6.118369; т.е. доля дисперсии, объясненная первым фактором равна приблизительно 61.2%. Заметим, что эти значения случайно оказались здесь легко сравнимыми, так как анализу подвергаются 10 переменных, и поэтому сумма всех собственных значений оказывается равной 10. Второй фактор включает в себя около 18% дисперсии. Остальные факторы содержат не более 5% общей дисперсии. Выбор числа факторов. В разделе Вводный обзор кратко описан способ, как полученные собственные значения можно использовать для решения вопроса о том, сколько факторов следует оставить в модели. В соответствии с критерием Кайзера (Kaiser, 1960), вы должны оставить факторы с собственными значениями большими 1. Из приведенной выше таблицы следует, что критерий приводит к выбору двух факторов.

Критерий каменистой осыпи . Теперь нажмите на кнопку График каменистой осыпи, чтобы получить график собственных значений с целью применения критерия осыпи Кэттеля (Cattell, 1966). График, представленный ниже, был дополнен отрезками, соединяющими соседние собственные значения, чтобы сделать критерий более наглядным. Кэттель (Cattell) утверждает, основываясь на методе Монте-Карло, что точка, где непрерывное падение собственных значений замедляется и после которой уровень остальных собственных значений отражает только случайный "шум". На графике, приведенном ниже, эта точка может соответствовать фактору 2 или 3 (как показано стрелками). Поэтому испытайте оба решения и посмотрите, которое из них дает более адекватную картину.

Теперь рассмотрим факторные нагрузки.

Факторные нагрузки . Как было описано в разделе Вводный обзор, факторные нагрузки можно интерпретировать как корреляции между факторами и переменными. Поэтому они представляют наиболее важную информацию, на которой основывается интерпретация факторов. Сначала посмотрим на (неповернутые) факторные нагрузки для всех десяти факторов. Во вкладке Нагрузки диалогового окна Результаты факторного анализа в поле Вращение факторов зададим значение без вращения и нажмем на кнопку Факторные нагрузки для отображения таблицы нагрузок.

Вспомним, что выделение факторов происходило таким образом, что последующие факторы включали в себя все меньшую и меньшую дисперсию (см. раздел Вводный обзор). Поэтому не удивительно, что первый фактор имеет наивысшую нагрузку. Отметим, что знаки факторных нагрузок имеют значение лишь для того, чтобы показать, что переменные с противоположными нагрузками на один и тот же фактор взаимодействуют с этим фактором противоположным образом. Однако вы можете умножить все нагрузки в столбце на -1 и обратить знаки. Во всем остальном результаты окажутся неизменными.

Вращение факторного решения. Как описано в разделе Вводный обзор, действительная ориентация факторов в факторном пространстве произвольна, и всякое вращение факторов воспроизводит корреляции так же хорошо, как и другие вращения. Следовательно, кажется естественным повернуть факторы таким образом, чтобы выбрать простейшую для интерпретации факторную структуру. Фактически, термин простая структура был придуман и определен Терстоуном (Thurstone, 1947) главным образом для описания условий, когда факторы отмечены высокими нагрузками на некоторые переменные и низкими - для других, а также когда имеются несколько больших перекрестных нагрузок, т.е. имеется несколько переменных с существенными нагрузками на более чем один фактор. Наиболее стандартными вычислительными методами вращения для получения простой структуры является метод вращения варимакс, предложенный Кайзером (Kaiser, 1958). Другими методами, предложенными Харманом (Harman, 1967), являются методы квартимакс, биквартимакс и эквимакс (см. Harman, 1967).

Выбор вращения . Сначала рассмотрим количество факторов, которое вы желаете оставить для вращения и интерпретации. Ранее было решено, что наиболее правдоподобным и приемлемым числом факторов является два, однако на основе критерия осыпи было решено учитывать также и решение с тремя факторами. Нажмите на кнопку Отмена для того, чтобы возвратиться в окно диалога Задайте метод выделения факторов, и измените поле Максимальное число факторов во вкладке Быстрый с 10 на 3, затем нажмите кнопку OK для того, чтобы продолжить анализ.

Теперь выполним вращение по методу варимакс. Во вкладке Нагрузки диалогового окна Результаты факторного анализа в поле Вращение факторов установите значение Варимакс исходных.

Нажмем кнопку Факторные нагрузки для отображения в таблице результатов получаемых факторных нагрузок.

Отображение решения при вращении трех факторов. В таблице приведены существенные нагрузки на первый фактор для всех переменных, кроме относящихся к дому. Фактор 2 имеет довольно значительные нагрузки для всех переменных, кроме переменных связанных с удовлетворенностью на работе. Фактор 3 имеет только одну значительную нагрузку для переменной Home_1. Тот факт, что на третий фактор оказывает высокую нагрузку только одна переменная, наводит на мысль, а не может ли получиться такой же хороший результат без третьего фактора?

Обозрение решения при вращении двух факторов . Снова нажмите на кнопку Отмена в окне диалога Результаты факторного анализа для того, чтобы возвратиться к диалоговому окну Задайте метод выделения факторов. Измените поле Максимальное число факторов во вкладке Быстрый с 3 до 2 и нажмите кнопку OK для того, чтобы перейти в диалоговое окно Результаты факторного анализа. Во вкладке Нагрузки в поле Вращение факторов установите значение Варимакс исходных и нажмите кнопку Факторные нагрузки.

Фактор 1, как видно из таблицы, имеет наивысшие нагрузки для переменных, относящихся к удовлетворенности работой. Наименьшие нагрузки он имеет для переменных, относящихся к удовлетворенности домом. Другие нагрузки принимают промежуточные значения. Фактор 2 имеет наивысшие нагрузки для переменных, связанных с удовлетворенностью дома, низшие нагрузки - для удовлетворенности на работе средние нагрузки для остальных переменных.

Интерпретация решения для двухфакторного вращения . Можно ли интерпретировать данную модель? Все выглядит так, как будто два фактора лучше всего идентифицировать как фактор удовлетворения работой (фактор 1) и как фактор удовлетворения домашней жизнью (фактор 2). Удовлетворение своим хобби и различными другими аспектами жизни кажется относящимися к обоим факторам. Эта модель предполагает в некотором смысле, что удовлетворенность работой и домашней жизнью согласно этой выборке могут быть независимыми друг от друга, но оба дают вклад в удовлетворение хобби и другими сторонами жизни.

Диаграмма решения, основанного на вращении двух факторов . Для получения диаграммы рассеяния двух факторов нажмите на кнопку 2М график нагрузок во вкладке Нагрузки диалогового окна Результаты факторного анализа. Диаграмма, показанная ниже, попросту показывает две нагрузки для каждой переменной. Заметим, что диаграмма рассеяния хорошо иллюстрирует два независимых фактора и 4 переменных (Hobby_1, Hobby_2, Miscel_1, Miscel_2) с перекрестными нагрузками.

Теперь посмотрим, насколько хорошо может быть воспроизведена наблюдаемая ковариационная матрица по двухфакторному решению.

Воспроизведенная и остаточная корреляционная матрица. Нажмите на кнопку Воспроизведенные и остаточные корреляции во вкладке Объясненная дисперсия, для того чтобы получить две таблицы с воспроизведенной корреляционной матрицей и матрицей остаточных корреляций (наблюдаемых минус воспроизведенных корреляций).

Входы в таблице Остаточных корреляций могут быть интерпретированы как "сумма" корреляций, за которые не могут отвечать два полученных фактора. Конечно, диагональные элементы матрицы содержат стандартное отклонение, за которое не могут быть ответственны эти факторы и которые равны квадратному корню из единица минус соответствующие общности для двух факторов (вспомним, что общностью переменной является дисперсия, которая может быть объяснена выбранным числом факторов). Если вы тщательно рассмотрите эту матрицу, то сможете увидеть, что здесь фактически не имеется остаточных корреляций, больших 0.1 или меньшие -0.1 (в действительности только малое количество из них близко к этой величине). Добавим к этому, что первые два фактора включают около 79% общей дисперсии (см. накопленный % собственных значений в таблице результатов).

"Секрет" удачного примера . Пример, который вы только что изучили, на самом деле дает решение двухфакторной задачи, близкое к идеальному. Оно определяет большую часть дисперсии, имеет разумную интерпретацию и воспроизводит корреляционную матрицу с умеренными отклонениями (остаточными корреляциями). На самом деле реальные данные редко позволяют получить такое простое решение, и в действительности это фиктивное множество данных было получено с помощью генератора случайных чисел с нормальным распределением, доступного в системе. Специальным образом в данные были "введены" два ортогональных (независимых) фактора, по которым были сгенерированы корреляции между переменными. Этот пример факторного анализа воспроизводит два фактора такими, как они и были, (т.е. фактор удовлетворенности работой и фактор удовлетворенности домашней жизнью). Таким образом, если бы явление (а не искусственные, как в примере, данные) содержало эти два фактора, то вы, выделив их, могли бы кое-что узнать о скрытой или латентной структуре явления.

Другие результаты . Прежде, чем сделать окончательное заключение, дадим краткие комментарии к другим результатам.

Общности . Для получения общностей решения нажмите на кнопку Общности во вкладке Объясненная дисперсия диалогового окна Результаты факторного анализа. Вспомним, что общность переменной - это доля дисперсии, которая может быть воспроизведена при заданном числе факторов. Вращение факторного пространства не влияет на величину общности. Очень низкие общности для одной или двух переменных (из многих в анализе) могут указывать на то, что эти переменные не очень хорошо объяснены моделью.

Коэффициенты значений. Коэффициенты факторов могут быть использованы для вычисления значений факторов для каждого наблюдения. Сами коэффициенты представляет обычно малый интерес, однако факторные значения полезны при проведении дальнейшего анализа. Для отображения коэффициентов нажмите кнопку Коэффициенты значений факторов во вкладке Значения диалогового окна Результаты факторного анализа.

Значения факторов. Факторные значения могут рассматриваться как текущие значения для каждого опрашиваемого респондента (т.е. для каждого наблюдения исходной таблицы данных). Кнопка Значения факторов во вкладке Значения диалогового окна Результаты факторного анализа позволяет вычислить факторные значения. Эти значения можно сохранить для дальнейшего нажатием кнопки Сохранить значения.

Заключительный комментарий. Факторный анализ - это непростая процедура. Всякий, кто постоянно использует факторный анализ со многими (например, 50 или более) переменными, мог видеть множество примеров "патологического поведения", таких, как: отрицательные собственные значения и не интерпретируемые решения, особые матрицы и т.д. Если вы интересуетесь применением факторного анализа для определения или значащих факторов при большом числе переменных, вам следует тщательно изучить какое-либо подробное руководство (например, книгу Хармана (Harman, 1968)). Таким образом, так как многие критические решения в факторном анализе по своей природе субъективны (число факторов, метод вращения, интерпретация нагрузок), будьте готовы к тому, что требуется некоторый опыт, прежде чем вы почувствуете себя уверенным в нем. Модуль Факторный анализ был разработан специально для того, чтобы сделать легким для пользователя интерактивное переключение между различным числом факторов, вращениями и т.д., так чтобы испытать и сравнить различные решения.

Этот пример взят из справочной системы ППП STATISTICA фирмы StatSoft

В общем случае для объяснения корреляционной матрицы потребуется не один, а несколько факторов. Каждый фактор характеризуется столбцом, каждая переменная - строкойматрицы . Фактор называется генеральным, если все его нагрузки значительно отличаются от нуля и он имеет нагрузки от всех переменных. Генеральный фактор имеет нагрузки от всех переменных и схематически такой фактор изображен на рис.1. столбцом .Фактор называется общим , если хотя бы две его нагрузки значительно отличаются от нуля. Столбцы , на рис. 1. представляют такие общие факторы. Они имеют нагрузки от более чем двух переменных. Если у фактора только одна нагрузка, значительно отличающаяся от нуля, то он называется характерным фактором (см. столбцы на рис. 1. ) Каждый такой фактор представляет только одну переменную. Решающее значение в факторном анализе имеют общие факторы. Если общие факторы установлены, то характерные факторы получаются автоматически. Число высоких нагрузок переменной на общие факторы называется сложностью . Например, переменная на рис.1. имеет сложность 2, а переменная - три.

Рис. 1. Схематическое изображение факторного отображения. Крестик означает высокую факторную нагрузку.

Итак, построим модель

![]() , (4)

, (4)

где - ненаблюдаемые факторы m < k ,

Наблюдаемые переменные (исходные признаки),

Факторные нагрузки,

Случайная ошибка связанная только с с нулевым средним и дисперсией :

И - некорpелированы,

Некоррелированные случайные величины с нулевым средним и единичной дисперсией ![]() .

.

![]() (5)

(5)

Здесь - i -ая общность представляющая собой часть дисперсии , обусловленная факторами, - часть дисперсии , обусловленная ошибкой. В матричной записи факторная модель примет вид:

![]() (6)

(6)

где - матрица нагрузок, - вектор факторов, - вектор ошибок.

Корреляции между переменными, выраженные факторами, можно вывести следующим образом:

где - диагональная матрица порядка , содержащая дисперсии ошибок[i]. Основное условие: - диагональная, - неотрицательно определенная матрица. Дополнительным условием единственности решения является диагональность матрицы .

Имеется множество методов решения факторного уравнения. Наиболее ранним методом факторного анализа является метод главных факторов , в котором методика анализа главных компонент используется применительно к редуцированной корреляционной матрице с общностями на главной диагонали. Для оценки общностей обычно пользуются коэффициентом множественной корреляции между соответствующей переменной и совокупностью остальных переменных.

Факторный анализ проводится исходя из характеристического уравнения, как и в анализе главных компонент:

![]() (8)

(8)

Решая которое, получают собственные числа λ i и матрицу нормированных (характеристических) векторов V, и затем находят матрицу факторного отображения:

![]()

Для получения оценок общностей и факторных нагрузок используется эмпирический итеративный алгоритм, который сходится к истинным оценкам параметров. Сущность алгоритма сводится к следующему: первоначальные оценки факторных нагрузок определяются с помощью метода главных факторов. На основании корреляционной матрицы R формально определяются оценки главных компонент и общих факторов:

(9)

(9)

где - соответствующее собственное значение матрицы R;

Исходные данные (вектор-столбцы);

Коэффициенты при общих факторах;

Главные компоненты (вектор-столбцы).

Оценками факторных нагрузок служат величины

Оценки общностей получаются как

На следующей итерации модифицируется матрица R - вместо элементов главной диагонали подставляются оценки общностей, полученные на предыдущей итерации; на основании модифицированной матрицы R с помощью вычислительной схемы компонентного анализа повторяется расчет главных компонент (которые не являются таковыми с точки зрения компонентного анализа), ищутся оценки главных факторов, факторных нагрузок, общностей, специфичностей. Факторный анализ можно считать законченным, когда на двух соседних итерациях оценки общностей меняются слабо.

Примечание. Преобразования матрицы R могут нарушать положительную определенность матрицы R + и, как следствие, некоторые собственные значения R + могут быть отрицательными.

ФАКТОРНЫЙ АНАЛИЗ

Идея факторного анализа

При исследовании сложных объектов, явлений, систем факторы, определяющие свойства этих объектов, очень часто невозможно измерить непосредственно, а иногда неизвестно даже их число и смысл. Но для измерения могут быть доступны другие величины, так или иначе зависящие от интересующих нас факторов. Причем, когда влияние неизвестного интересующего нас фактора проявляется в нескольких измеряемых признаках или свойствах объекта, эти признаки могут обнаруживать тесную связь между собой и общее число факторов может быть гораздо меньше, чем число измеряемых переменных.

Для выявления факторов, определяющих измеряемые признаки объектов, используются методы факторного анализа

В качестве примера применения факторного анализа можно указать изучение свойств личности на основе психологических тестов. Свойства личности не поддаются прямому измерению. О них можно судить только по поведению человека или характеру ответов на вопросы. Для объяснения результатов опытов их подвергают факторному анализу, который и позволяет выявить те личностные свойства, которые оказывают влияние на поведение индивидуума.

В основе различных методов факторного анализа лежит следующая гипотеза: наблюдаемые или измеряемые параметры являются лишь косвенными характеристиками изучаемого объекта, в действительности существуют внутренние (скрытые, латентные, не наблюдаемые непосредственно) параметры и свойства, число которых мало и которые определяют значения наблюдаемых параметров. Эти внутренние параметры принято называть факторами.

Цель факторного анализа – сконцентрировать исходную информацию, выражая большое число рассматриваемых признаков через меньшее число более ёмких внутренних характеристик явления, которые, однако, не поддаются непосредственному измерению

Установлено, что выделение и последующее наблюдение за уровнем общих факторов даёт возможность обнаруживать предотказные состояния объекта на очень ранних стадиях развития дефекта. Факторный анализ позволяет отслеживать стабильность корреляционных связей между отдельными параметрами. Именно корреляционные связи между параметрами, а также между параметрами и общими факторами содержат основную диагностическую информацию о процессах. Применение инструментария пакета Statistica при выполнении факторного анализа исключает необходимость использования дополнительных вычислительных средств и делает анализ наглядным и понятным для пользователя.

Результаты факторного анализа будут успешными, если удается дать интерпретацию выявленных факторов, исходя из смысла показателей, характеризующих эти факторы. Данная стадия работы весьма ответственная; она требует чёткого представления о содержательном смысле показателей, которые привлечены для анализа и на основе которых выделены факторы. Поэтому при предварительном тщательном отборе показателей для факторного анализа следует руководствоваться их смыслом, а не стремлением к включению в анализ как можно большего их числа.

Сущность факторного анализа

Приведём несколько основных положений факторного анализа. Пусть для матрицы Х измеренных параметров объекта существует ковариационная (корреляционная) матрица C , где р – число параметров, n – число наблюдений. Путем линейного преобразования X =QY +U можно уменьшить размерность исходного факторного пространства Х до уровня Y , при этом р "<<р . Это соответствует преобразованию точки, характеризующей состояние объекта в j -мерном пространстве, в новое пространство измерений с меньшей размерностью р ". Очевидно, что геометрическая близость двух или множества точек в новом факторном пространстве означает стабильность состояния объекта.

Матрица Y содержит ненаблюдаемые факторы, которые по существу являются гиперпараметрами, характеризующими наиболее общие свойства анализируемого объекта. Общие факторы чаще всего выбирают статистически независимыми, что облегчает их физическую интерпретацию. Вектор наблюдаемых признаков Х имеет смысл следствия изменения этих гиперпараметров.

Матрица U

состоит из остаточных факторов, которые включают в основном ошибки измерения признаков x

(i

). Прямоугольная матрица Q

содержит факторные нагрузки, определяющие линейную связь между признаками и гиперпараметрами.

Факторные нагрузки – это значения коэффициентов корреляции каждого из исходных признаков с каждым из выявленных факторов. Чем теснее связь данного признака с рассматриваемым фактором, тем выше значение факторной нагрузки. Положительный знак факторной нагрузки указывает на прямую (а отрицательный знак – на обратную) связь данного признака с фактором.

Таким образом, данные о факторных нагрузках позволяют сформулировать выводы о наборе исходных признаков, отражающих тот или иной фактор, и об относительном весе отдельного признака в структуре каждого фактора.

Модель факторного анализа похожа на модели многомерного регрессионного и дисперсионного анализа. Принципиальное отличие модели факторного анализа в том, что вектор Y – это ненаблюдаемые факторы, а в регрессионном анализе – это регистрируемые параметры. В правой части уравнения (8.1) неизвестными являются матрица факторных нагрузок Q и матрица значений общих факторов Y.

Для нахождения матрицы факторных нагрузок используют уравнениеQQ т =S–V,

где Q т – транспонированная матрица Q, V – матрица ковариаций остаточных факторов U, т.е. . Уравнение решается путем итераций при задании некоторого нулевого приближения ковариационной матрицы V(0).

После нахождения матрицы факторных нагрузок Q вычисляются общие факторы (гиперпараметры) по уравнению

Y=(Q т V -1)Q -1 Q т V -1 X

Пакет статистического анализа Statistica позволяет в диалоговом режиме вычислить матрицу факторных нагрузок, а также значения нескольких заранее заданных главных факторов, чаще всего двух – по первым двум главным компонентам исходной матрицы параметров.

Факторный анализ в системе Statistica

Рассмотрим последовательность выполнения факторного анализа на примере обработки результатов анкетного опроса работников предприятия . Требуется выявить основные факторы, которые определяют качество трудовой жизни.

На первом этапе необходимо отобрать переменные для проведения факторного анализа. Используя корреляционный анализ, исследователь пытается выявить взаимосвязь исследуемых признаков, что, в свою очередь, даёт ему возможность выделить полный и безызбыточный набор признаков путём объединения сильно коррелирующих признаков.

Если проводить факторный анализ по всем переменным, то результаты могут получиться не совсем объективными, так как некоторые переменные определяется другими данными, и не могут регулироваться сотрудниками рассматриваемой организации.

Для того чтобы понять, какие показатели следует исключить, построим по имеющимся данным матрицу коэффициентов корреляции в Statistica: Statistics/ Basic Statistics/ Correlation Matrices/ Ok. В стартовом окне этой процедуры Product-Moment and Partial Correlations (рис. 4.3) для расчёта квадратной матрицы используется кнопка One variable list. Выбираем все переменные (select all), Ok, Summary. Получаем корреляционную матрицу.

Если коэффициент корреляции изменяется в пределах от 0,7 до 1, то это означает сильную корреляцию показателей. В этом случае можно исключить одну переменную с сильной корреляцией. И наоборот, если коэффициент корреляции мал, можно исключить переменную из-за того, что она ничего не добавит к общей сумме. В нашем случае сильной корреляции между какими-либо переменными не наблюдается, и факторный анализ будем проводить для полного набора переменных.

Для запуска факторного анализа необходимо вызвать модуль Statistics/ Multivariate Exploratory Techniques (многомерные исследовательские методы)/ Factor Analysis (факторный анализ). На экране появится окно модуля Factor Analysis.

Для анализа выбираем все переменные электронной таблицы; Variables (переменные): select all, Ok. В строке Input file (тип файла входных данных) указывается Raw Data (исходные данные). В модуле возможны два типа исходных данных – Raw Data (исходные данные) и Correlation Matrix – корреляционная матрица.

В разделе MD deletion задаётся способ обработки пропущенных значений:

* Casewise – способ исключения пропущенных значений (по умолчанию);

* Pairwise – парный способ исключения пропущенных значений;

* Mean substitution – подстановка среднего вместо пропущенных значений.

Способ Casewise состоит в том, что в электронной таблице, содержащей данные, игнорируются все строки, в которых имеется хотя бы одно пропущенное значение. Это относится ко всем переменным. В способе Pairwise игнорируются пропущенные значения не для всех переменных, а лишь для выбранной пары.

Выберем способ обработки пропущенных значений Casewise.

Statistica обработает пропущенные значения тем способом, который указан, вычислит корреляционную матрицу и предложит на выбор несколько методов факторного анализа.

После нажатия кнопки Ok появляется окно Define Method of Factor Extraction (определить метод выделения факторов).

Верхняя часть окна является информационной. Здесь сообщается, что пропущенные значения обработаны методом Casewise. Обработано 17 наблюдений и 17 наблюдений принято для дальнейших вычислений. Корреляционная матрица вычислена для 7 переменных. Нижняя часть окна содержит 3 вкладки: Quick, Advanced, Descriptives.

Во вкладке Descriptives (описательные статистики) имеются две кнопки:

1- просмотреть корреляции, средние и стандартные отклонения;

2- построить множественную регрессию.

Нажав на первую кнопку, можно посмотреть средние и стандартные отклонения, корреляции, ковариации, построить различные графики и гистограммы.

Во вкладке Advanced, в левой части, выберем метод (Extraction method) факторного анализа: Principal components (метод главных компонент). В правой части выбираем максимальное число факторов (2). Задаётся либо максимальное число факторов (Max no of factors), либо минимальное собственное значение: 1 (eigenvalue).

Нажимаем Ok, и Statistica быстро произвёдет вычисления. На экране появляется окно Factor Analysis Results (результаты факторного анализа). Как говорилось ранее, результаты факторного анализа выражаются набором факторных нагрузок. Поэтому далее будем работать с вкладкой Loadings.

Верхняя часть окна – информационная:

Number of variables (число анализируемых переменных): 7;

Method (метод выделения факторов): Principal components (главных компонент);

Log (10) determinant of correlation matrix (десятичный логарифм детерминанта корреляционной матрицы): –1,6248;

Number of factors extracted (число выделенных факторов): 2;

Eigenvalues (собственные значения): 3,39786 и 1,19130.

В нижней части окна находятся функциональные кнопки, позволяющие всесторонне просмотреть результаты анализа, числено и графически.

Factor rotation – вращение факторов, в данном выпадающем окне можно выбрать различные повороты осей. С помощью поворота системы координат можно получить множество решений, из которого необходимо выбрать интерпретируемое решение.

Существуют различные методы вращения координат пространства. Пакет Statistica предлагает восемь таких методов, представленных в модуле факторного анализа. Так, например, метод варимакс соответствует преобразованию координат: вращение, максимизирующее дисперсию. В методе варимакс получают упрощённое описание столбцов факторной матрицы, сводя все значения к 1 или 0. При этом рассматривается дисперсия квадратов нагрузок фактора. Факторная матрица, получаемая с помощью метода вращения варимакс, в большей степени инвариантна по отношению к выбору различных множеств переменных.

Вращение методом квартимакс ставит целью аналогичное упрощение только по отношению к строкам факторной матрицы. Эквимакс занимает промежуточное положение? при вращении факторов по этому методу одновременно делается попытка упростить и столбцы, и строки. Рассмотренные методы вращения относятся к ортогональным вращениям, т.е. в результате получаются некоррелированные факторы. Методы прямого облимина и промакс вращения относятся к косоугольным вращениям, в результате которых получаются коррелированные между собой факторы. Термин?normalized? в названиях методов указывает на то, что факторные нагрузки нормируются, то есть делятся на квадратный корень из соответствующей дисперсии.

Из всех предлагаемых методов, мы сначала посмотрим результат анализа без вращения системы координат – Unrotated. Если полученный результат окажется интерпретируемым и будет нас устраивать, то на этом можно остановиться. Если нет, можно вращать оси и посмотреть другие решения.

Щёлкаем по кнопке "Factor Loading" и смотрим факторные нагрузки численно.

Напомним, что факторные нагрузки – это значения коэффициентов корреляции каждой из переменных с каждым из выявленных факторов.

Значение факторной нагрузки, большее 0,7 показывает, что данный признак или переменная тесно связан с рассматриваемым фактором. Чем теснее связь данного признака с рассматриваемым фактором, тем выше значение факторной нагрузки. Положительный знак факторной нагрузки указывает на прямую (а отрицательный знак? на обратную) связь данного признака с фактором.

Итак, из таблицы факторных нагрузок было выявлено два фактора. Первый определяет ОСБ – ощущение социального благополучия. Остальные переменные обусловлены вторым фактором.

В строке Expl. Var (рис. 8.5) приведена дисперсия, приходящаяся на тот или иной фактор. В строке Prp. Totl приведена доля дисперсии, приходящаяся на первый и второй фактор. Следовательно, на первый фактор приходится 48,5 % всей дисперсии, а на второй фактор – 17,0 % всей дисперсии, всё остальное приходится на другие неучтенные факторы. В итоге, два выявленных фактора объясняют 65,5 % всей дисперсии.

Здесь мы также видим две группы факторов – ОСБ и остальное множество переменных, из которых выделяется ЖСР – желание сменить работу. Видимо, имеет смысл исследовать это желание более основательно на основе сбора дополнительных данных.

Выбор и уточнение количества факторов

Как только получена информация о том, сколько дисперсии выделил каждый фактор, можно возвратиться к вопросу о том, сколько факторов следует оставить. По своей природе это решение произвольно. Но имеются некоторые общеупотребительные рекомендации, и на практике следование им даёт наилучшие результаты.

Количество общих факторов (гиперпараметров) определяется путём вычисления собственных чисел (рис. 8.7) матрицы Х в модуле факторного анализа. Для этого во вкладке Explained variance (рис. 8.4) необходимо нажать кнопку Scree plot.

Максимальное число общих факторов может быть равно количеству собственных чисел матрицы параметров. Но с увеличением числа факторов существенно возрастают трудности их физической интерпретации.

Сначала можно отобрать только факторы, с собственными значениями, большими 1. По существу, это означает, что если фактор не выделяет дисперсию, эквивалентную, по крайней мере, дисперсии одной переменной, то он опускается. Этот критерий используется наиболее широко. В приведённом выше примере на основе этого критерия следует сохранить только 2 фактора (две главные компоненты).

Можно найти такое место на графике, где убывание собственных значений слева направо максимально замедляется. Предполагается, что справа от этой точки находится только "факториальная осыпь". В соответствии с этим критерием можно оставить в примере 2 или 3 фактора.

Из рис. видно, что третий фактор незначительно увеличивает долю общей дисперсии.

Факторный анализ параметров позволяет выявить на ранней стадии нарушение рабочего процесса (возникновение дефекта) в различных объектах, которое часто невозможно заметить путём непосредственного наблюдения за параметрами. Это объясняется тем, что нарушение корреляционных связей между параметрами возникает значительно раньше, чем изменение одного параметра. Такое искажение корреляционных связей позволяет своевременно обнаружить факторный анализ параметров. Для этого достаточно иметь массивы зарегистрированных параметров.

Можно дать общие рекомендации по использованию факторного анализа вне зависимости от предметной области.

* На каждый фактор должно приходиться не менее двух измеренных параметров.

* Число измерений параметров должно быть больше числа переменных.

* Количество факторов должно обосновываться, исходя из физической интерпретации процесса.

* Всегда следует добиваться того, чтобы количество факторов было намного меньше числа переменных.

Критерий Кайзера иногда сохраняет слишком много факторов, в то время как критерий каменистой осыпи иногда сохраняет слишком мало факторов. Однако оба критерия вполне хороши при нормальных условиях, когда имеется относительно небольшое число факторов и много переменных. На практике более важен вопрос о том, когда полученное решение может быть интерпретировано. Поэтому обычно исследуется несколько решений с большим или меньшим числом факторов, и затем выбирается одно наиболее осмысленное.

Пространство исходных признаков должно быть представлено в однородных шкалах измерения, т. к. это позволяет при вычислении использовать корреляционные матрицы. В противном случае возникает проблема "весов" различных параметров, что приводит к необходимости применения при вычислении ковариационных матриц. Отсюда может появиться дополнительная проблема повторяемости результатов факторного анализа при изменении количества признаков. Следует отметить, что указанная проблема просто решается в пакете Statistica путем перехода к стандартизированной форме представления параметров. При этом все параметры становятся равнозначными по степени их связи с процессами в объекте исследования.

Если в наборе исходных данных имеются избыточные переменные и не проведено их исключение корреляционным анализом, то нельзя вычислить обратную матрицу (8.3). Например, если переменная является суммой двух других переменных, отобранных для этого анализа, то корреляционная матрица для такого набора переменных не может быть обращена, и факторный анализ принципиально не может быть выполнен. На практике это происходит, когда пытаются применить факторный анализ к множеству сильно зависимых переменных, что иногда случается, например, в обработке вопросников. Тогда можно искусственно понизить все корреляции в матрице путём добавления малой константы к диагональным элементам матрицы, и затем стандартизировать её. Эта процедура обычно приводит к матрице, которая может быть обращена, и поэтому к ней применим факторный анализ. Более того, эта процедура не влияет на набор факторов, но оценки оказываются менее точными.

Факторное и регрессионное моделирование систем с переменными состояниямиСистемой с переменными состояниями (СПС) называется система, отклик которой зависит не только от входного воздействия, но и от обобщенного постоянного во времени параметра, определяющего состояние. Регулируемый усилитель или аттенюатор? это пример простейшей СПС, в котором коэффициент передачи может дискретно или плавно изменяться по какому-либо закону. Исследование СПС обычно проводится для линеаризованных моделей, в которых переходный процесс, связанный с изменением параметра состояния, считается завершённым.

Аттенюаторы, выполненные на основе Г-, Т- и П-образного соединения последовательно и параллельно включённых диодов получили наибольшее распространение. Сопротивление диодов под воздействием управляющего тока может меняться в широких пределах, что позволяет изменять АЧХ и затухание в тракте. Независимость фазового сдвига при регулировании затухания в таких аттенюаторах достигается с помощью реактивных цепей, включенных в базовую структуру. Очевидно, что при разном соотношении сопротивлений параллельных и последовательных диодов может быть получен один и тот же уровень вносимого ослабления. Но изменение фазового сдвига будет различным.

Исследуем возможность упрощения автоматизированного проектирования аттенюаторов, исключающего двойную оптимизацию корректирующих цепей и параметров управляемых элементов. В качестве исследуемой СПС будем использовать электрически управляемый аттенюатор, схема замещения которого приведена на рис. 8.8. Минимальный уровень затухания обеспечивается в случае малого сопротивления элемента Rs и большого сопротивления элемента Rp. По мере увеличения сопротивления элемента Rs и уменьшения сопротивления элемента Rp вносимое ослабление увеличивается.

Зависимости изменения фазового сдвига от частоты и затухания для схемы без коррекции и с коррекцией приведены на рис. 8.9 и 8.10 соответственно. В корректированном аттенюаторе в диапазоне ослаблений 1,3-7,7 дБ и полосе частот 0,01?4,0 ГГц достигнуто изменение фазового сдвига не более 0,2°. В аттенюаторе без коррекции изменение фазового сдвига в той же полосе частот и диапазоне ослаблений достигает 3°. Таким образом, фазовый сдвиг уменьшен за счет коррекции почти в 15 раз.

Будем считать параметры коррекции и управления независимыми переменными или факторами, влияющими на затухание и изменение фазового сдвига. Это даёт возможность с помощью системы Statistica провести факторный и регрессионный анализ СПС с целью установления физических закономерностей между параметрами цепи и отдельными характеристиками, а также упрощения поиска оптимальных параметров схемы.

Исходные данные формировались следующим образом. Для параметров коррекции и сопротивлений управления, отличающихся от оптимальных в большую и меньшую стороны на сетке частот 0,01?4 ГГц, были вычислены вносимое ослабление и изменение фазового сдвига.

Методы статистического моделирования, в частности, факторный и регрессионный анализ, которые раньше не использовались для проектирования дискретных устройств с переменными состояниями, позволяют выявить физические закономерности работы элементов системы. Это способствует созданию структуры устройства исходя из заданного критерия оптимальности. В частности, в данном разделе рассматривался фазоинвариантный аттенюатор как типичный пример системы с переменными состояниями. Выявление и интерпретация факторных нагрузок, влияющих на различные исследуемые характеристики, позволяет изменить традиционную методологию и существенно упростить поиск параметров коррекции и параметров регулирования.

Установлено, что использование статистического подхода к проектированию подобных устройств оправдано как для оценки физики их работы, так и для обоснования принципиальных схем. Статистическое моделирование позволяет существенно сократить объём экспериментальных исследований.

Результаты

- Наблюдение за общими факторами и соответствующими факторными нагрузками – это необходимое выявление внутренних закономерностей процессов.

- С целью определения критических значений контролируемых расстояний между факторными нагрузками следует накапливать и обобщать результаты факторного анализа для однотипных процессов.

- Применение факторного анализа не ограничено физическими особенностями процессов. Факторный анализ является как мощным методом мониторинга процессов, так и применим к проектированию систем самого различного назначения.

Основные положения

Факторный анализ – это один из новых разделов многомерного статистического анализа. Первоначально этот метод разрабатывался для объяснения корреляции между исходными параметрами. Результатом корреляционного анализа является матрица коэффициентов корреляции. При малом числе признаков (переменных) можно провести визуальный анализ этой матрицы. С ростом числа признаков (10 и более) визуальный анализ не даст положительных результатов. Оказывается, что все многообразие корреляционных связей можно объяснить действием нескольких обобщенных факторов, которые являются функциями исследуемых параметров, при этом сами факторы могут быть неизвестны, но их можно выразить через исследуемые признаки. Основоположником факторного анализа является американский ученый Л.Терстоун.

Современные статистики под факторным анализом понимают совокупность методов, которые на основе реально существующей связи между признаками позволяет выявить латентные (скрытые) обобщающие характеристики организационной структуры и механизмы развития изучаемых явлений и процессов.

Пример: предположим, что n автомобилей оценивается по 2 признакам:

x 1 – стоимость автомобиля,

x 2 – длительность рабочего ресурса мотора.

При условии коррелированности x 1 и x 2 в системе координат появляется направленное и достаточно плотное скопление точек, формально отображаемое новыми осями и(Рис.5).

Рис.6

Рис.6

Характерная особенность F 1 и F 2 заключается в том, что они проходят через плотные скопления точек и в свою очередь коррелируют с x 1 x 2 .Максимальное

число новых осей будет равно числу элементарных признаков. Дальнейшие разработки факторного анализа показали, что этот метод может быть с успехом применены в задачах группировки и классификации объектов.

Представление информации в факторном анализе.

Для проведения факторного анализа информация должна быть представлена в виде матрицы размером m x n:

Строки матрицы соответствуют объектам наблюдений (i=), а столбцы – признакам (j=).

Признаки, характеризующие объект имеют разную размерность. Для того, чтобы их привести к одной размерности и обеспечить сопоставимость признаков матрицу исходных данных обычно нормируют, вводя единый масштаб. Самым распространенным способом нормировки является стандартизация. От переменных переходят к переменным

Среднее значение j признака,

Среднеквадратическое отклонение.

Такое преобразование называется стандартизацией.

Основная модель факторного анализа

Основная модель факторного анализа имеет вид:

z j – j -й признак (величина случайная);

F 1 , F 2 , …, F p – общие факторы (величины случайные, нормально распределенные);

u j – характерный фактор;

j1 , j2 , …, jp – факторы нагрузки, характеризующие существенность влияния каждого фактора (параметры модели, подлежащие определению);

Общие факторы имеют существенное значение для анализа всех признаков. Характерные факторы показывают, что он относится только к данному -му признаку, это специфика признака, которая не может быть выражена через факторы. Факторные нагрузки j1 , j2 , …, jp характеризуют величину влияния того или иного общего фактора в вариации данного признака. Основная задача факторного анализа – определить факторные нагрузки. Дисперсию S j 2 каждого признака, можно разделить на 2 составляющие:

первая часть обуславливает действие общих факторов – общность h j 2 ;

вторая часть обуславливает действие характерного фактора –характерность - d j 2 .

Все переменные представлены в стандартизованном виде, поэтому дисперсия - гопризнака S j 2 = 1.

Если общие и характерные факторы не коррелируют между собой, то дисперсию j-го признака можно представить в виде:

где - доля дисперсии признака, приходящаяся на k -ый фактор.

Полный вклад какого-либо фактора в суммарную дисперсию равен:

Вклад всех общих факторов в суммарную дисперсию:

Результаты факторного анализа удобно представить в виде таблицы.

|

Факторные нагрузки |

Общности |

|

|

a 11 a 21 … a p1 a 12 a 22 … a p2 … … … … a 1m a 2m … a pm | ||

|

факторов |

V 1 V 2 … V p |

А - матрица факторных нагрузок. Ее можно получить различными способами, в настоящее время наиболее распространение получил метод главных компонент или главных факторов.

Вычислительная процедура метода главных факторов.

Решение задачи с помощью главных компонент сводится к поэтапному преобразованию матрицы исходных данных X :

Х - матрица исходных данных;

Z – матрица стандартизированных значений признаков,

R – матрица парных корреляций:

Диагональная матрица собственных (характеристических) чисел,

j находят решением характеристического уравнения

Е –единичная матрица,

j – показатель дисперсии каждой главной компоненты ,

при условии стандартизации исходных данных , тогда=m

U – матрица собственных векторов, которые находят из уравнения:

Реально это означает решение m систем линейных уравнений для каждого

Т.е. каждому собственному числу соответствует система уравнений.

Затем находят V - матрицу нормированных собственных векторов.

Матрицу факторного отображения А вычисляют по формуле:

Затем находим значения главных компонент по одной из эквивалентных формул:

Совокупность из четырех промышленных предприятий оценена по трем характерным признакам:

среднегодовая выработка на одного работника х 1 ;

уровень рентабельности х 2 ;

Уровень фондоотдачи х 3.

Результат представлен в стандартизированной матрице Z :

По матрице Z получена матрица парных корреляций R :

![]()

Найдем определитель матрицы парных корреляций(например методом Фаддеева):

Построим характеристическое уравнение:

Решая это уравнение найдем:

Таким образом исходные элементарные признаки х 1 , х 2 , х 3 могут быть обобщены значениями трех главных компонент, причем:

F 1 объясняет примерно всей вариации,

F 2 - , аF 3 -

Все три главные компоненты объясняют вариации полностью на 100%.

![]()

Решая эту систему находим:

Аналогично строятся системы для 2 и 3 . Для 2 решение системы:

Матрица собственных векторов U принимает вид:

Каждый элемент матрицы разделим на сумму квадратов элементов j-го

столбца, получим нормированную матрицу V .

![]()

Отметим, что должно выполнятся равенство =E .

Матрицу факторного отображения получим из матричного соотношения

=

=

По смыслу каждый элемент матрицы А представляет частные коэффициенты матрицы корреляции между исходным признаком x j и главными компонентами F r . Поэтому все элементы .

Из равенства следует условиеr - число компонент .

Полный вклад каждого фактора в суммарную дисперсию признаков равен:

Модель факторного анализа примет вид:

![]()

Найдем значения главных компонент (матрицу F ) по формуле

Центр распределения значений главных компонент находится в точке (0,0,0).

Далее аналитические выводы по результатам расчетов следуют уже после принятия решения о числе значащих признаков и главных компоненти определения названий главным компонентам. Задачи распознавания главных компонент, определения для них названий решают субъективно на основе весовых коэффициентовиз матрицы отображенияА .

Рассмотрим вопрос формулировки названий главных компонент.

Обозначим w 1 – множество незначимых весовых коэффициентов, в которое включаются близкие к нулю элементы,,

w 2 - множество значимых весовых коэффициентов,

w 3 – подмножество значимых весовых коэффициентов, не участвующих в формировании названия главной компоненты.

w 2 - w 3 – подмножество весовых коэффициентов, участвующих в формировании названия.

Вычисляем коэффициент информативности для каждого главного фактора

Набор объяснимых признаков считаем удовлетворительным, если значения коэффициентов информативности лежат в пределах 0,75-0,95.

a 11 =0,776 a 12 =-0,130 a 13 =0,308

a 12 =0,904 a 22 =-0,210 a 23 =-0,420

а 31 =0,616 а 32 =0,902 а 33 =0,236

Для j=1 w 1 = ,w 2 ={a 11 ,a 21 ,a 31 },

![]() .

.

Для j=2 w 1 ={ a 12 , a 22 }, w 2 ={ а 32 },

Для j=3 w 1 ={ а 33 }, w 2 ={a 13 ,a 33 },

Значениями признаков x 1 , x 2 , x 3 определяется состав главной компоненты на 100%. при этом наибольший вклад признакаx 2 , смысл которого-рентабельность. корректным для названия признака F 1 будет эффективность производства .

F 2 определяется компонентой x 3 (фондоотдача), назовем ее эффективность использования основных производственных средств .

F 3 определяется компонентами x 1 ,x 2 –в анализе может не рассматриваться т.к. она объясняет всего 10% общей вариации.

Литература.

Попов А.А.

Excel: Практическое руководство, ДЕСС КОМ.-М.-2000.

Дьяконов В.П., Абраменкова И.В. Mathcad7 в математике, физике и в Internet. Изд-во « Номидж», М.-1998, раздел 2.13. Выполнение регрессии.

Л.А. Сошникова, В.Н. Томашевич и др. Многомерный статистический анализ в экономике под ред. В.Н. Томашевича.- М. –Наука, 1980.

Колемаев В.А., О.В. Староверов, В.Б. Турундаевский Теория вероятностей и математическая статистика. –М. – Высшая школа- 1991.

К Иберла. Факторный анализ.-М. Статистика.-1980.

|

Сравнение двух средних нормальных генеральных совокупностей, дисперсии которых известны |

|

Пусть генеральные совокупности X и Y распределены нормально, причем их дисперсии известны (например из предшествующего опыта или найдены теоретически). По независимым выборкам объемов n и m, извлеченным из этих совокупностей, найдены выборочные средние x в и y в. Требуется по выборочным средним при заданном уровне значимости проверить нулевую гипотезу, состоящую в том, что генеральные средние (математические ожидания) рассматриваемых совокупностей равны между собой, т. е. Н 0: М(X) = М(Y). Учитывая, что выборочные средние являются несмещенными оценками генеральных средних, т. е. М(x в) = М(X) и М(y в) = М(Y), нулевую гипотезу можно записать так: Н 0: М(x в) = М(y в). Таким образом, требуется проверить, что математические ожидания выборочных средних равны между собой. Такая задача ставится, потому что, как правило, выборочные средние являются различными. Возникает вопрос: значимо или незначимо различаются выборочные средние? Если окажется, что нулевая гипотеза справедлива, т. е. генеральные средние одинаковы, то различие выборочных средних незначимо и объясняется случайными причинами и, в частности, случайным отбором объектов выборки. Если нулевая гипотеза будет отвергнута, т. е. генеральные средние неодинаковы, то различие выборочных средних значимо и не может быть объяснено случайными причинами. А объясняется тем, что сами генеральные средние (математические ожидания) различны. В качестве проверки нулевой гипотезы примем случайную величину. Критерий Z – нормированная нормальная случайная величина. Действительно, величина Z распределена нормально, так как является линейной комбинацией нормально распределенных величин X и Y; сами эти величины распределены нормально как выборочные средние, найденные по выборкам, извлеченным из генеральных совокупностей; Z – нормированная величина, потому что М(Z) = 0, при справедливости нулевой гипотезы D(Z) = 1, поскольку выборки независимы. Критическая область строится в зависимости от вида конкурирующей гипотезы. Первый случай . Нулевая гипотеза Н 0:М(X)=М(Y). Конкурирующая гипотеза Н 1: М(X) ¹М(Y). В этом случае строят двустороннюю критическую область исходя из требования, чтобы вероятность попадания критерия в эту область, в предположении справедливости нулевой гипотезы, была равна принятому уровню значимости . Наибольшая мощность критерия (вероятность попадания критерия в критическую область при справедливости конкурирующей гипотезы) достигается тогда, когда «левая» и «правая» критические точки выбраны так, что вероятность попадания критерия в каждый интервал критической области равна: P(Z < zлев.кр)=a¤2, P(Z > zправ.кр)=a¤2. (1) Поскольку Z – нормированная нормальная величина, а распределение такой величины симметрично относительно нуля, критические точки симметричны относительно нуля. Таким образом, если обозначить правую границу двусторонней критической области через zкр, то левая граница -zкр. Итак, достаточно найти правую границу, чтобы найти саму двустороннюю критическую область Z < -zкр, Z > zкр и область принятия нулевой гипотезы (-zкр, zкр). Покажем, как найти zкр – правую границу двусторонней критической области, используя функцию Лапласа Ф(Z). Известно, что функция Лапласа определяет вероятность попадания нормированной нормальной случайной величины, например Z, в интервале (0;z): Р(0

< Z Так

как распределение Z симметрично

относительно нуля, то вероятность

попадания Z в интервал (0; ¥) равна 1/2.

Следовательно, если разбить этот

интервал точкой zкр на интервал (0, zкр)

и (zкр, ¥), то по теореме сложения Р(0<

Z < zкр)+Р(Z > zкр)=1/2. В

силу (1) и (2) получим Ф(zкр)+a/2=1/2.

Следовательно,

Ф(zкр) =(1-a)/2. Отсюда

заключаем: для того чтобы найти правую

границу двусторонней критической

области (zкр), достаточно найти значение

аргумента функции Лапласа, которому

соответствует значение функции, равное

(1-a)/2. Тогда

двусторонняя критическая область

определяется неравенствами Z < –

zкр, Z > zкр, или равносильным неравенством

½Z½ > zкр, а область принятия нулевой

гипотезы неравенством – zкр < Z <

zкр или равносильным неравенством çZ

ç< zкр. Обозначим

значение критерия, вычисленное по

данным наблюдений, через zнабл и

сформулируем правило проверки нулевой

гипотезы. Правило.

1.

Вычислить наблюдаемое значение

критерия 2.

По таблице функции Лапласа найти

критическую точку по равенству

Ф(zкр)=(1-a)/2. 3.

Если ç zнабл ç < zкр – нет оснований

отвергнуть нулевую гипотезу. Если

ç zнабл ç> zкр – нулевую гипотезу

отвергают. Второй

случай

.

Нулевая гипотеза Н0: M(X)=M(Y). Конкурирующая

гипотеза Н1: M(X)>M(Y). На

практике такой случай имеет место,

если профессиональные соображения

позволяют предположить, что генеральная

средняя одной совокупности больше

генеральной средней другой. Например,

если введено усовершенствование

технологического процесса, то

естественно допустить, что оно приведет

к увеличению выпуска продукции. В

этом случае строят правостороннюю

критическую область исходя из

требования, чтобы вероятность попадания

критерия в эту область, в предположении

справедливости нулевой гипотезы, была

равна принятому уровню значимости: P(Z>

zкр)=a.

(3) Покажем,

как найти критическую точку при помощи

функции Лапласа. Воспользуемся

соотношением P(0 В

силу (2) и (3) имеем Ф(zкр)+a=1/2.

Следовательно,

Ф(zкр)=(1-2a)/2. Отсюда

заключаем, для того чтобы найти границу

правосторонней критической области

(zкр), достаточно найти значение функции

Лапласа, равное (1-2a)/2. Тогда правосторонняя

критическая область определяется

неравенством Z > zкр, а область принятия

нулевой гипотезы – неравенством Z <

zкр. Правило.

1.

Вычислить наблюдаемое значение

критерия zнабл. 2.

По таблице функции Лапласа найти

критическую точку из равенства

Ф(zкр)=(1-2a)/2. 3.

Если Z набл <

z кр –

нет оснований отвергнуть нулевую

гипотезу. Если Z набл >

z кр –

нулевую гипотезу отвергаем. Третий

случай.

Нулевая

гипотеза Н0: M(X)=M(Y). Конкурирующая

гипотеза Н1: M(X) В

этом случае строят левостороннюю

критическую область исходя из

требования, вероятность попадания

критерия в эту область, в пред- положении

справедливости нулевой гипотезы, была

равна принятому уровню значимости

P(Z < z’кр)=a, т.е. z’кр= – zкр. Таким

образом, для того чтобы найти точку

z’кр, достаточно сначала найти

“вспомогательную точку” zкр а затем

взять найденное значение со знаком

минус. Тогда левосторонняя критическая

область определяется неравенством Z

< -zкр, а область принятия нулевой

гипотезы – неравенством Z > -zкр. Правило.

1.

Вычислить Zнабл. 2.

По таблице функции Лапласа найти

“вспомогательную точку” zкр по

равенству Ф(zкр)=(1-2a)/2, а затем положить

z’кр = -zкр. 3.

Если Zнабл > -zкр, – нет оснований

отвергать нулевую гипотезу. Если

Zнабл < -zкр, – нулевую гипотезу

отвергают. |

Факторный анализ - это ветвь математической статистики. Его цели, как и цель других разделов математической статистики, заключается в разработке моделей, понятий и методов, позволяющих анализировать и интерпретировать массивы экспериментальных или наблюдаемых данных вне зависимости от их физической формы.

Одной из наиболее типичных форм представления экспериментальных данных является матрица, столбцы которой соответствуют различным параметрам, свойствам, тестам и т.п., а строки - отдельным объектам, явлениям, режимам, описываемым набором конкретных значений параметров. На практике размеры матрицы оказываются достаточно большими: так, число строк этой матрицы может колебаться от нескольких десятков до нескольких сотен тысяч (например, при социологических обследованиях), а число столбцов - от одного - двух до нескольких сотен. Непосредственный, “визуальный”, анализ матриц такого размера невозможен, поэтому в математической статистике возникло много подходов и методов, предназначенных для того, чтобы “сжать” исходную информацию, заключенную в матрице, до обозримых размеров, извлечь из исходной информации наиболее “существенное”, отбросив “второстепенное”, “случайное”.

При анализе данных, представленных в форме матрицы, возникают два типа задач. Задачи первого типа имеют целью получить “короткое описание” распределения объектов, а задачи второго - выявить взаимоотношения между параметрами.

Следует иметь в виду, что основной стимул для появления указанных задач заключается не только и не столько в желании коротко закодировать большой массив чисел, а в значительно более принципиальном обстоятельстве, имеющем методологический характер: коль скоро удалось коротко описать большой массив чисел, то можно верить, что вскрыта некая объективная закономерность, обусловившая возможность короткого описания; а ведь именно поиск объективных закономерностей и является основной целью, ради которой, как правило, и собираются данные.

Упомянутые подходы и методы обработки матрицы данных отличаются тем, какого типа задачи обработки данных они предназначены решать, и тем, к матрицам какого размера они применимы.

Что же касается проблемы короткого описания связей между параметрами при среднем числе этих параметров, то в данном случае соответствующая корреляционная матрица содержит несколько десятков или сотен чисел и сама по себе она еще не может служить “коротким описанием” существующих связей между параметрами, а должна с этой целью подвергнуться дальнейшей обработке.

Факторный анализ как раз и представляет собой набор моделей и методов, предназначенных для “сжатия” информации, содержащейся в корреляционной матрице. В основе различных моделей факторного анализа лежит следующая гипотеза: наблюдаемые или измеряемые параметры являются лишь косвенными характеристиками изучаемого объекта или явления, на самом же деле существуют внутренние (скрытые, не наблюдаемые непосредственно) параметры или свойства, число которых мало и которые определяют значения наблюдаемых параметров. Эти внутренние параметры принято называть факторами. Задача факторного анализа - представить наблюдаемые параметры в виде линейных комбинаций факторов и, может быть, некоторых дополнительных, “не существенных” величин - “помех”. Замечательным является тот факт, что, хотя сами факторы не известны, такое разложение может быть получено и, более того, такие факторы могут быть определены, т.е. для каждого объекта могут быть указаны значения каждого фактора.

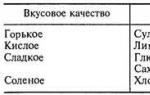

Факторный анализ, независимо от используемых методов, начинается с обработки таблицы интеркорреляций, полученных на множестве тестов, известной как корреляционная матрица, а заканчивается получением факторной матрицы, т.е. таблицы, показывающей вес или нагрузку каждого из факторов по каждому тесту. Таблица 1 представляет собой гипотетическую факторную матрицу, включающую всего два фактора.

Факторы перечисляются в верхней строке таблицы от более значимого к менее значимому, а их веса в каждом из 10 тестов даны в соответствующих столбцах.

Таблица 1

Гипотетическая факторная матрица

Оси координат. Принято представлять факторы геометрически в виде осей координат, относительно которых каждый тест может быть изображен в виде точки. Рис. 1 поясняет эту процедуру. На этом графике каждый из 10 тестов, приведенных в табл.1, отображен в виде точки относительно двух факторов, которые соответствуют осям I и II. Так, тест 1 представлен точкой с координатами 0,74 по оси I и 0,54 по оси II. Точки, представляющие остальные 9 тестов, построены аналогичным способом, с использованием значений весов из табл. 1.

Следует заметить, что положение осей координат не фиксировано данными. Исходная таблица корреляций определяет лишь положение тестов (т.е. точек на рис. 1) относительно друг друга. Те же точки можно нанести на плоскость с любым положением координатных осей. По этой причине при проведении факторного анализа обычно вращают оси до тех пор, пока не получают наиболее приемлемого и легко интерпретируемого отображения.

Рис. 1. Гипотетическое факторное отображение, показывающее веса двух групповых факторов по каждому из 10 тестов.

На рис. 1 полученные после вращения оси I" и II" показаны пунктирными линиями. Это вращение выполнено в соответствии с предложенными Терстоуном критериями положительного многообразия и простой структуры. Первый предполагает вращение осей до положения, при котором исключаются все значимые отрицательные веса. Большинство психологов считают отрицательные факторные нагрузки логически несоответствующими тестам способностей, так как такая нагрузка означает, что чем выше оценка индивидуума по специфическому фактору, тем ниже будет его результат по соответствующему тесту. Критерий простой структуры, в сущности, означает, что каждый тест должен иметь нагрузки по как можно меньшему числу факторов.

Выполнение обоих критериев дает факторы, которые можно наиболее легко и однозначно интерпретировать. Если тест имеет высокую нагрузку по одному фактору и не имеет значимых нагрузок по другим факторам, мы можем кое-что узнать о природе этого фактора, изучив содержание данного теста. Напротив, если тест имеет средние или низкие нагрузки по шести факторам, то он мало что скажет нам о природе любого из них.

На рис. 1 хорошо видно, что после вращения осей координат все вербальные тесты (1-5) располагаются вдоль или очень близко к оси I", а числовые тесты (6-10) тесно группируются вокруг оси II". Новые факторные нагрузки, измеренные относительно повернутых осей, приведены в табл. 2. Факторные нагрузки в табл. 2 не имеют отрицательных значений, за исключением пренебрежительно малых величин, явно относимых к ошибкам выборки. Все вербальные тесты имеют высокие нагрузки по фактору I" и практически нулевые - по фактору II". Числовые тесты, напротив, имеют высокие нагрузки по фактору II" и пренебрежимо низкие - по фактору I". Таким образом, вращение координатных осей существенно упростило идентификацию и называние обоих факторов, а также описание факторного состава каждого теста. На практике число факторов часто оказывается больше двух, что, разумеется, усложняет их геометрическое представление и статистический анализ, но не изменяет существа рассмотренной процедуры.

Таблица 2

Факторная матрица после вращения

Некоторые исследователи руководствуются теоретической моделью как принципом вращения осей. Кроме того, принимается в расчет неизменность, или подтверждение одних и тех же факторов в независимо выполненных, но сравнимых исследованиях.

Интерпретация факторов. Получив после процедуры вращения факторное решение (или, проще говоря, факторную матрицу), мы можем переходить к интерпретации и наименованию факторов. Этот этап работы скорее требует психологической интуиции, нежели статистической подготовки. Чтобы понять природу конкретного фактора, нам ничего не остается, как изучить тесты, имеющие высокие нагрузки по этому фактору, и попытаться обнаружить общие для них психологические процессы. Чем больше оказывается тестов с высокими нагрузками по данному фактору, тем легче раскрыть его природу. Из табл. 2, к примеру, сразу видно, что фактор I" вербальный, а фактор II" числовой. Приведенные в табл. 2 факторные нагрузки отображают к тому же корреляцию каждого теста с фактором.